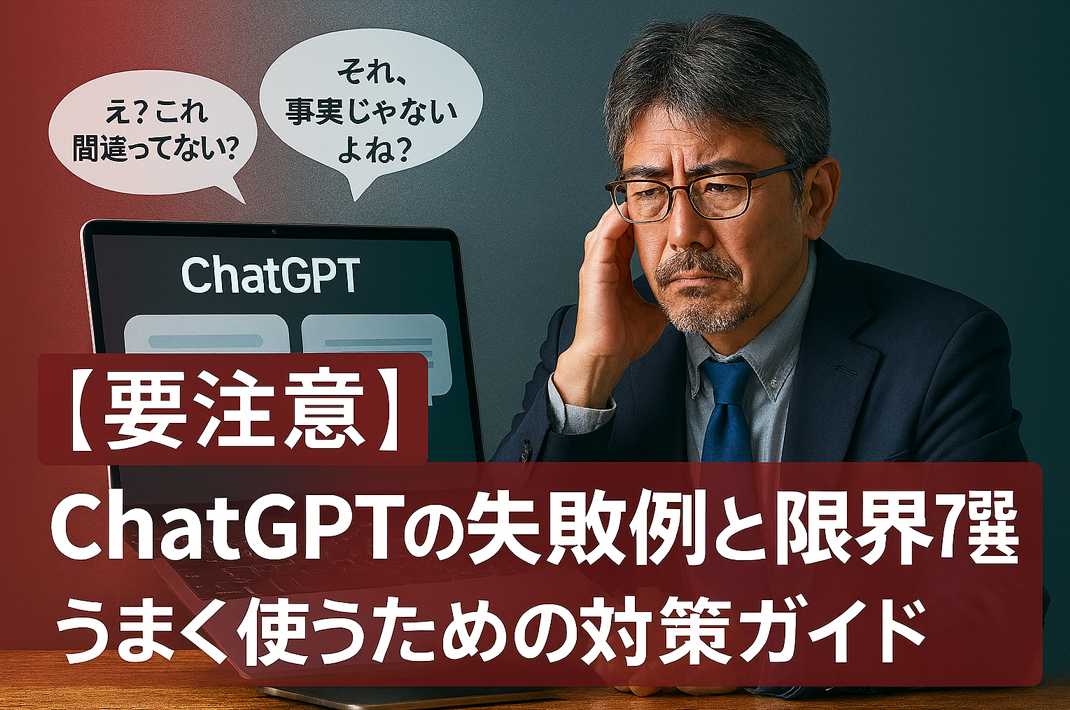

ChatGPTでよくある失敗・困った例

ChatGPTは非常に高性能なAIチャットツールですが、万能ではありません。むしろ、「なんか変だぞ?」「これ、本当に正しいの?」と違和感を覚えた経験がある方も多いはずです。

ここでは、実際のユーザーからよく寄せられるChatGPTの失敗・困りごと7例を紹介します。

❶ 誤った情報を堂々と語る

最も多いのがこれです。ChatGPTは正確な事実を保証するわけではなく、「それらしく」話すことを得意とします。そのため、ありもしない論文や人物をでっち上げることも。

❷ 論理矛盾や前後不一致の回答

会話の途中で主張が変わったり、直前の内容と矛盾する回答が返ってきたりすることがあります。長い対話になるほど、文脈がずれていく傾向にあります。

❸ 言い回しが堅苦しい・不自然

「ご査収のほどよろしくお願いいたします」など、実務ではやや堅すぎる言葉を使ってくることがあります。自然な表現にするにはプロンプトで調整が必要です。

❹ 要約が偏る/重要な情報が抜ける

長文を要約させると、表面のキーワードは拾っても、本当に重要な論点が抜け落ちてしまうことがあります。

❺ 文章が長すぎ/短すぎ

「もっと短くして」と頼んでも長々とした回答が返ってくる、あるいは要点が簡略されすぎて意味が薄くなる、といったバランスの悪さも起こります。

❻ 日本語がぎこちない or 誤訳

特にビジネスメールや技術用語を含む翻訳では、意味が逆になるような訳ミスもあります。英語→日本語翻訳では敬語やニュアンスが不自然なことも。

❼ プロンプトに忠実すぎて柔軟性がない

「こう書いて」と指示すると、AIは非常に素直に従います。しかし、背景や状況を“理解して工夫する”能力には限界があります。文脈に応じた柔軟性が不足する場合も。

このような失敗を経験すると、「AIはやっぱり使えない」と感じてしまうかもしれません。ですが、これらはすべて仕組み上の“クセ”や“限界”

次章では、こうした失敗がなぜ起きるのか、ChatGPTの構造的な限界について解説していきます。

なぜ失敗する?GPTの仕組みと限界

ChatGPTを使っていて「なぜこんな回答になるんだ?」と思ったことはありませんか? それは、ChatGPTの基本構造=言語予測モデルによる限界に起因しています。

🧠GPTは「言語を予測するAI」

GPTは「次に来そうな単語を予測する」ことで文章を生成します。つまり、情報を検索して正解を出すAIではなく、もっともらしい文を“創作”するAIなのです。

そのため、知識の根拠が曖昧だったり、事実とは異なる内容を自信満々に語ったりすることがよくあります。

📚検索エンジンとAIチャットの違い

- Google検索:公開情報から正確な事実を探す

- ChatGPT:学習した膨大な言語パターンから回答を予測する

つまり、ChatGPTは「本当のことを言っている」わけではなく、「そう言いそうな文を出している」だけ。これが、誤情報や文脈ミスの原因になります。

🔄文脈保持の限界

ChatGPTは会話の履歴をある程度記憶しますが、完全ではありません。特に長文になったり、複数の話題が交錯すると、前後のつながりが崩れることがあります。

🧭最新情報に弱い

GPT-3.5やGPT-4は、2023年またはそれ以前のデータで学習しています。新しい法律、製品、トレンドについては知らないか、誤った内容を出すリスクがあります。

💡仕組みを理解すれば“使いどころ”が見えてくる

これらの限界は避けられませんが、前提を知っておけば誤用を防げます。例えば、「事実確認には使わない」「要点整理や案出しに特化して使う」などの工夫が可能です。

次章では、このような限界を乗り越えるためのプロンプト設計術を紹介します。AIに“うまく指示を出す”だけで、結果がガラッと変わるのです。

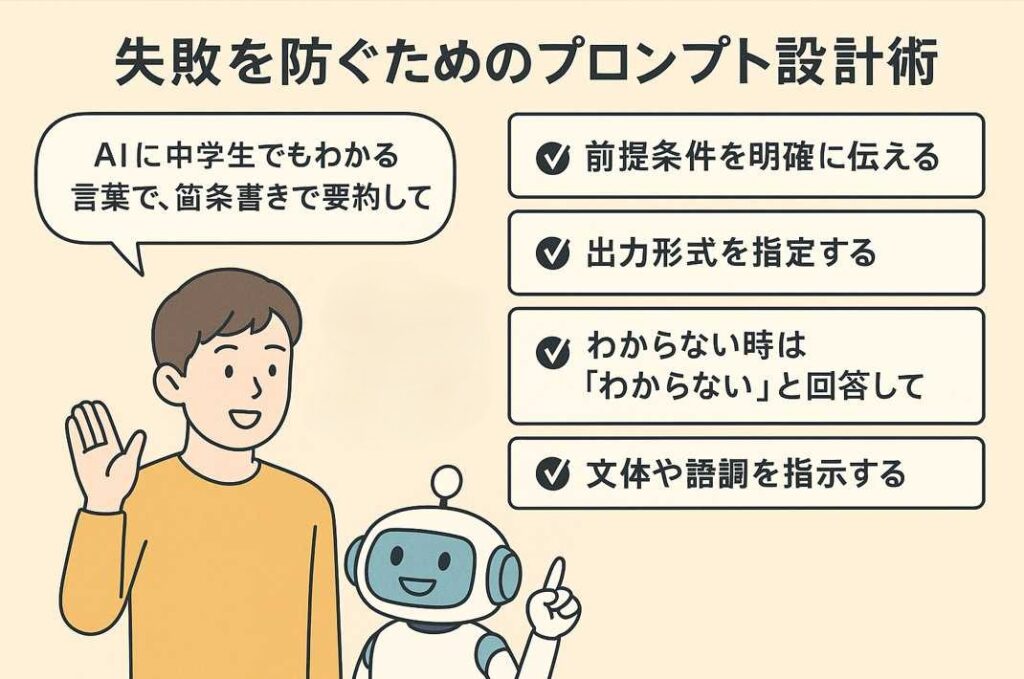

失敗を防ぐためのプロンプト設計術

ChatGPTの出力がうまくいかない原因の多くは、「AIの性能が低い」からではなく、こちらの指示(プロンプト)が曖昧であることがほとんどです。

つまり、AIを“うまく使いこなす力”は、プロンプト次第。ここでは、失敗を減らすためのプロンプト設計のコツと、すぐに使えるテンプレ例をご紹介します。

✅ コツ①:前提条件を明確に伝える

AIは行間を読んでくれません。誰に向けた文章なのか、どんな目的かを最初に示すことで、出力の精度がぐっと上がります。

あなたは広報担当者です。以下の文を、社外向けのお知らせメールとして丁寧に書き直してください。

✅ コツ②:出力形式を具体的に指定する

「箇条書きで」「200文字以内で」「表形式で」など、出力の形を指定すると、AIが迷わず書いてくれます。

以下の内容を、3行の要点・箇条書きでまとめてください。

✅ コツ③:「わからないときは“わからない”と答えて」と明示

AIは無理にでも答えを出そうとします。誤情報を避けたいときは、あらかじめ「自信がない場合は“わかりません”と答えてください」と指示しましょう。

この内容に関する確実な情報がない場合は「わかりません」と答えてください。

✅ コツ④:文体や語調の指示も有効

「中学生にもわかる言葉で」「やさしい口調で」などスタイルの指定も出力品質を安定させるポイントです。

以下の文を、小学生にもわかる言葉で、やさしい口調に直してください。

📋 よく使うプロンプトテンプレ集

- 要約:「以下の文章を200文字以内で要約してください」

- 比較表:「以下の2つの製品を、価格・機能・対象者で比較してください」

- 敬語変換:「この文をビジネスメール向けに敬語で書き直してください」

プロンプト設計に慣れてくると、ChatGPTは一貫性のある、高精度なアウトプットを返してくれるようになります。

次章では、そもそもChatGPTだけに頼らず、用途や精度に応じてツールを使い分ける方法について解説します。

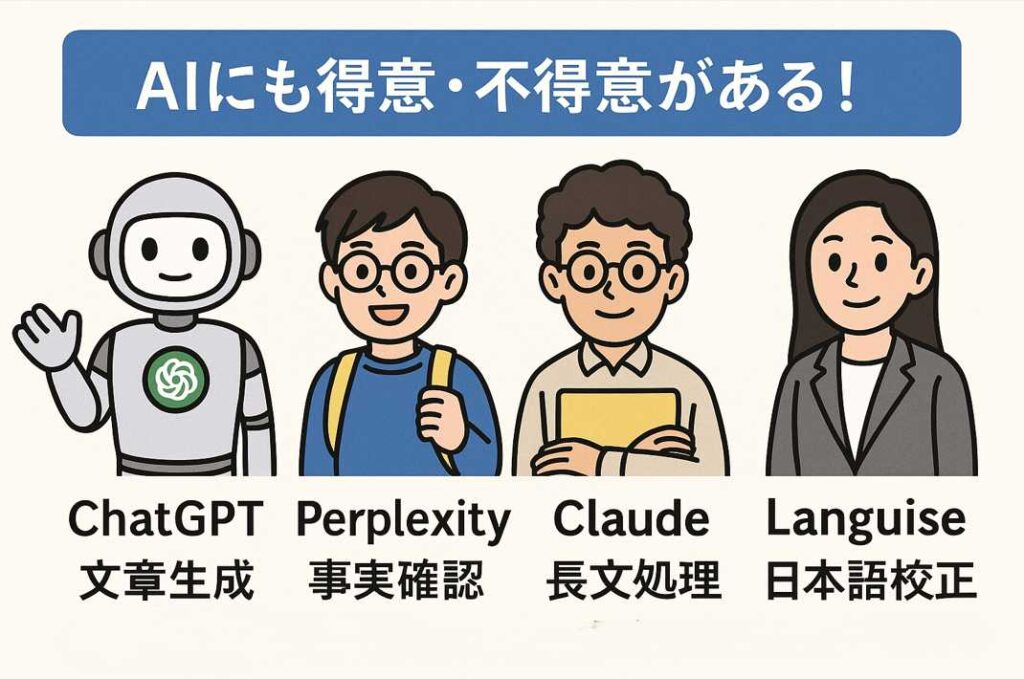

ツール選びでも限界回避ができる

ChatGPTには優れた点がたくさんある一方で、前章で挙げたような限界や失敗も避けられません。ですが、その弱点を補えるツールも数多く存在します。

つまり、ChatGPTだけにこだわる必要はなく、目的や場面に応じてAIツールを使い分けることが、失敗を防ぐカギなのです。

🧠ChatGPT(OpenAI)

- 得意:文章生成・会話・要約・ストーリー作成

- 弱点:情報の正確性、最新情報の取得、長文文脈の保持

- おすすめ用途:構成案、文章のたたき台作成、メール下書き

🔍Perplexity

- 得意:検索型AI、情報の正確性・引用元提示

- 弱点:日本語の自然さ、長文生成力

- おすすめ用途:事実確認、資料調査、比較データ取得

📜Claude(Anthropic)

- 得意:長文処理、論理的な要約、落ち着いた文章表現

- 弱点:やや硬めの文体、ユーモアや遊び心は少なめ

- おすすめ用途:議事録要約、法務・技術文書の確認

🈶Languise(ランギス)

- 得意:日本語校正、敬語チェック、自然な翻訳

- 弱点:高度な推論や創作系の指示には弱い

- おすすめ用途:ビジネス文書の校正、翻訳支援

💡「どれかひとつ」ではなく「場面で切り替える」発想を

AIツールにはそれぞれ特徴があり、万能なものは存在しません。だからこそ、「調べるときはPerplexity」「要約はClaude」「自然な敬語はLanguise」のように、適材適所で使い分けることが重要です。

また、特定の作業には「プロンプトテンプレ+ツールの組み合わせ」を事前に決めておくと、誰でも安定した結果が得られる“AI活用の型化”が可能になります。

次章では、こうした知見を踏まえたうえで、AIチャットを賢く使いこなす心構えと、次に読むべきおすすめ記事をご紹介します。

まとめ:失敗を学び、賢く使いこなそう

ChatGPTや他のAIチャットツールは、もはや業務のあらゆる場面で活用できるパートナーとなりつつあります。しかし、便利さの裏には必ず限界や落とし穴も存在します。

AIを“正しく信じる”のではなく、“うまく付き合う”。これがAI時代の基本姿勢です。

👣AIとのつきあい方のポイント

- 100%正しいと思い込まない

- 出力は必ず人間がチェックする

- 状況に応じてツールを使い分ける

- プロンプトの型を持って指示を出す

ChatGPTは「魔法の答えを出す装置」ではなく、考えるための補助ツールです。意図を明確にすればするほど、優れた回答が返ってくるようになります。

AIの失敗例は「だから使えない」という結論ではなく、どう使えばいいかのヒントとして活かすべきです。

📚あわせて読みたい関連記事

最後にひとこと。

失敗から学べる人が、AIを一番うまく使いこなします。

ぜひ、明日からの実務に役立ててください。